স্টিভ সালগ্রা রেমা

আসন্ন নির্বাচনে মাঠের লড়াইয়ে প্রার্থীরা জড়াচ্ছেন বাকযুদ্ধে। একইসঙ্গে অনুসারীদের মাধ্যমে রাজত্ব চালাচ্ছেন ডিজিটাল মাধ্যমেও। এরই অংশ হিসেবে এআই দিয়ে ভুয়া ভিডিও বানিয়ে চলছে ভোটের প্রচার ও প্রতিপক্ষ ঘায়েল।

এসব ভিডিওতে জনমত প্রভাবিত করতে কখনো আইনশৃঙ্খলা রক্ষাকারী বাহিনীর পোশাক ব্যবহার করে নির্দিষ্ট দল বা প্রার্থীর পক্ষে-বিপক্ষে বক্তব্য জুড়ে দেওয়া হচ্ছে। আবার কখনো জনপ্রিয় তারকা ও পরিচিত ব্যক্তির নামে সাজানো ছবি-বার্তা ছড়িয়ে দেওয়া হচ্ছে। আচরণবিধি লঙ্ঘন করে এসব হলেও নির্বিকার নির্বাচন কমিশন (ইসি)।

‘রাজনৈতিক দল ও প্রার্থীর আচরণ বিধিমালা, ২০২৫’– এ সামাজিক মাধ্যম নিয়ে আলাদা বিধান রয়েছে। বিধি ১৬–তে বলা হয়েছে, নির্বাচন-সম্পর্কিত বিষয়ে অসৎ উদ্দেশ্যে এআই ব্যবহার ও ভুয়া অথবা ক্ষতিকর কনটেন্ট তৈরি-প্রচার নিষিদ্ধ।

সম্প্রতি ফেসবুকে নির্বাচন নিয়ে ১৮ সেকেন্ডের ভিডিও ছড়িয়ে পড়ে, যাতে সেনাবাহিনীর পোশাকে একজনকে জামায়াতে ইসলামীর ‘দাঁড়িপাল্লা’ প্রতীকে ভোট চাইতে দেখা যাচ্ছে। যাচাইয়ে স্ট্রিম এই ভিডিওর কণ্ঠস্বর ও পরিবেশগত উপস্থাপনায় কিছু অসঙ্গতি পেয়েছে। হাইভ ডিটেক্ট এআই প্ল্যাটফর্ম ভিডিওটি এআই নির্মিত হওয়ার উচ্চ সম্ভাবনা দেখায়। বাস্তবে এটি কৃত্রিম বুদ্ধিমত্তা ব্যবহারে তৈরি ভুয়া ভিডিও।

আবার সাবেক সেনাপ্রধান জেনারেল এস এম শফিউদ্দিন আহমেদের একটি ভিডিও ছড়িয়েছে, যাতে বিএনপি প্রার্থীদের ‘চোর-বাটপার’ বলে ভালো মানুষকে ভোট দিতে বলা হচ্ছে। অনুসন্ধানে জানা যায়, বাস্তবে শফিউদ্দিন আহমেদ এ ধরনের মন্তব্য করেননি। রিভার্স ইমেজ সার্চে দেখা যায়, ভিডিওর দৃশ্যটি ২০২৩ সালে টাঙ্গাইলে সেনাবাহিনীর শীতকালীন অনুশীলনের চূড়ান্ত মহড়ার ফুটেজ (১,২) থেকে নেওয়া এবং এআইয়ের মাধ্যমে বিভ্রান্তিকর বক্তব্য জুড়ে দেওয়া হয়েছে।

এমন আরেক ভিডিওতে সেনাবাহিনীর পোশাকে নিজেকে লেফটেন্যান্ট কর্নেল আজমাতুল্লাহ পরিচয় দিয়ে জামায়াতের বিপক্ষে ভোট দেওয়ার আহ্বান জানাচ্ছেন। ফ্যাক্টচেক প্রতিবেদন বলছে, সেনা কর্মকর্তার এই বক্তব্য দাবিতে প্রচার ভিডিও এআই নির্মিত।

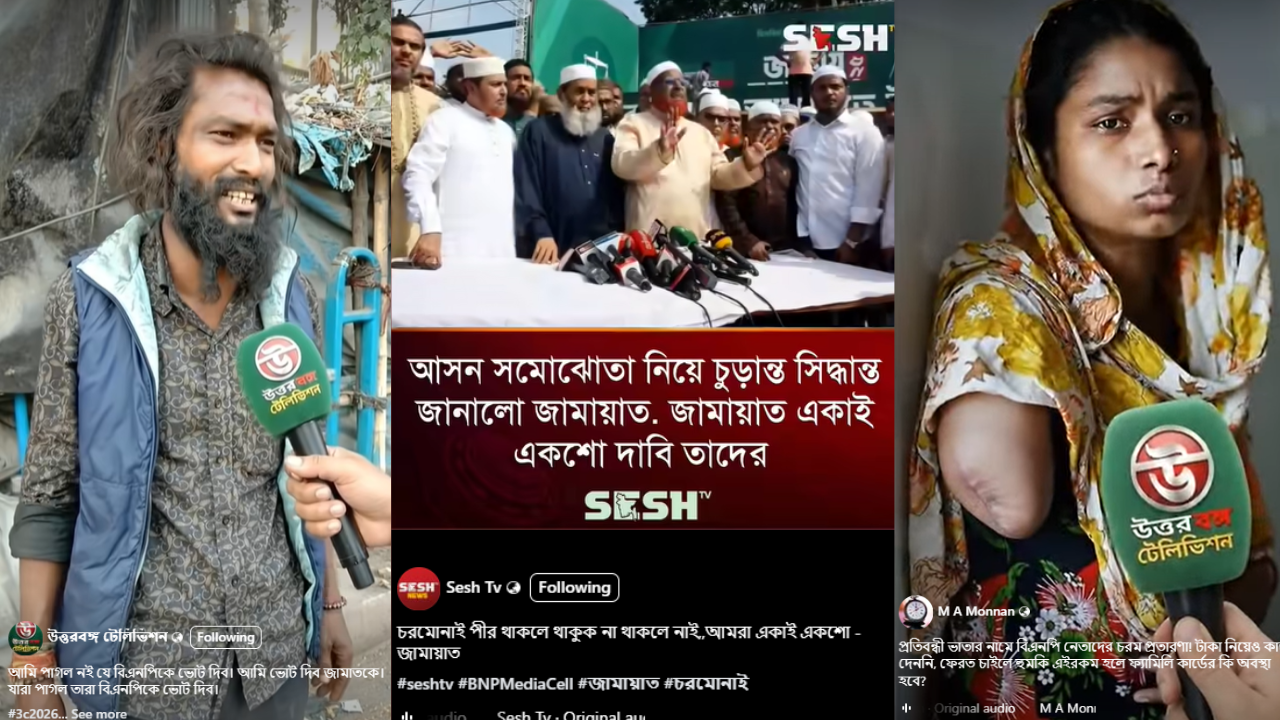

ভোটারের সহানুভূতি আদায়ে এআই নির্মিত ভিডিও ব্যবহার করা হচ্ছে। ফেসবুকের একটি ভিডিওতে এক নারী বলছেন– প্রতিবন্ধী কার্ডের কথা বলে এক বিএনপি নেতা টাকা নিয়েও কার্ড দেননি। তাই তিনি বিএনপিকে ভোট দেবেন না; দাঁড়িপাল্লায় ভোট দেবেন। মূলত উত্তরবঙ্গ টেলিভিশন নামের ফেসবুক অ্যাকাউন্ট থেকে গত ১০ জানুয়ারি ভিডিওটি প্রথম পোস্ট করা হয়।

প্রতিবেদন অনুযায়ী, ভিডিওটি একটি স্থির ছবি থেকে প্রযুক্তির সাহায্যে ডিপফেক হিসেবে তৈরি করা। ভিডিও থেকে নেওয়া কি-ফ্রেম রিভার্স সার্চে ২০১৩ সালে এনবিসি নিউজে প্রকাশিত একটি প্রতিবেদনে (রানা প্লাজা দুর্ঘটনায় ডান হাত হারানো) রিক্তার ছবি পাওয়া যায়। তবে একই নারীর এই বক্তব্যসহ ভিডিও কোথাও পাওয়া যায়নি। ভিডিওতে মুখের ভঙ্গিমা এবং স্বাভাবিক কথোপকথনে অসঙ্গতি, এমনকি অডিওতে অস্বাভাবিকতা স্পষ্ট। গুগলের এআই টুল ও সংশ্লিষ্ট ওয়াটারমার্ক শনাক্ত (সিন্থআইডি) পরীক্ষায় ভিডিওটি এআই দিয়ে তৈরির প্রমাণ পাওয়া যায়।

ফেসবুকে সাম্প্রতিক সময়ে আবেগকে কাজে লাগিয়ে তৈরি এমন বহু ভুয়া কনটেন্ট ছড়িয়ে পড়েছে। জানুয়ারিতে ফেসবুকে কয়েকটি ছবি (১,২,৩) ছড়িয়ে পড়ে, যেখানে খল অভিনেতা ডিপজল, অভিনেতা জিয়াউল হক পলাশ এবং ক্রিকেটার মাহমুদউল্লাহ রিয়াদকে একটি প্ল্যাকার্ড ধরে শেখ হাসিনা ও আওয়ামী লীগের প্রতি সমর্থন জানাচ্ছেন। প্ল্যাকার্ডে লেখা ছিল— ‘ফ্যাসিস্ট দিয়ে যদি ভালো কিছু হয়। তবে ফ্যাসিস্টই ভালো।’ প্রতিবেদন অনুযায়ী, ছবিগুলো বাস্তব নয়; এগুলো কৃত্রিম বুদ্ধিমত্তা ব্যবহার করে তৈরি।

এবার নির্বাচনে ভাইরাল এআই নির্মিত কনটেন্টের মাধ্যমে প্রতিপক্ষকে কোণঠাসা করার কৌশল নতুন মাত্রা পেয়েছে। রাজনৈতিক পদত্যাগ ও আসনবণ্টনের মতো স্পর্শকাতর বিষয় ব্যবহার করে বিভ্রান্তি ছড়ানো হচ্ছে বেশি। জাতীয় নাগরিক পার্টির (এনসিপি) সিনিয়র যুগ্ম সদস্যসচিব পদ থেকে ডা. তাসনিম জারা পদত্যাগ করার পর টিকটকে একটি ভিডিও ছড়ানো হয়, যেখানে তাঁকে ‘এনসিপি রাজাকারদের একটি দল’ বলতে দেখা যায়। অনুসন্ধানে এই বক্তব্যের পক্ষে কোনো প্রমাণ পাওয়া যায়নি। তাসনিম জারার ফেসবুক পোস্টেও এনসিপি নিয়ে এমন মন্তব্য নেই। প্রতিবেদনে উল্লেখ করা হয়, ‘ডিপফেক-ও-মিটার’-এর ‘জিএলএফএফ (২০২৪)’ মডেলে পরীক্ষা করে ভিডিওটি কৃত্রিমভাবে তৈরি হওয়ার সম্ভাবনা শতভাগ পাওয়া যায়।

নয়াদিল্লির দ্য ওবেরয় হোটেলে ভারতের গোয়েন্দা সংস্থা ‘র’-এর এক কর্মকর্তার সঙ্গে বিএনপি নেতা আবদুল আউয়াল মিন্টু ও আমীর খসরু মাহমুদ চৌধুরীর বৈঠকের দৃশ্য দেখিয়ে ফেসবুকে চারটি ছবি ছড়ানো হয়। এই বিষয়ে দ্য ডিসেন্ট বলছে, ছবিগুলো কৃত্রিমভাবে তৈরি ও সম্পাদিত। অন্তত একটি ছবির ব্যাকগ্রাউন্ড ৬ বছর আগে নয়াদিল্লির ওবেরয় হোটেলের গুগল রিভিউতে পোস্ট করা একটি বাস্তব ছবি থেকে নেওয়া, যা পরে বিকৃত করে নতুন দৃশ্য তৈরি করা হয়েছে। একাধিক ওপেনসোর্স শনাক্তকরণ টুলেও একটি ছবিকে নিশ্চিতভাবে কৃত্রিমভাবে তৈরি বলে চিহ্নিত করা হয়। ছবিগুলোর উৎস হিসেবে Indus Sentinel Grid নামের একটি এক্স অ্যাকাউন্ট পাকিস্তান থেকে পরিচালিত এবং আগেও ভিত্তিহীন বিভ্রান্তিকর তথ্য ছড়ানোর রেকর্ড রয়েছে।

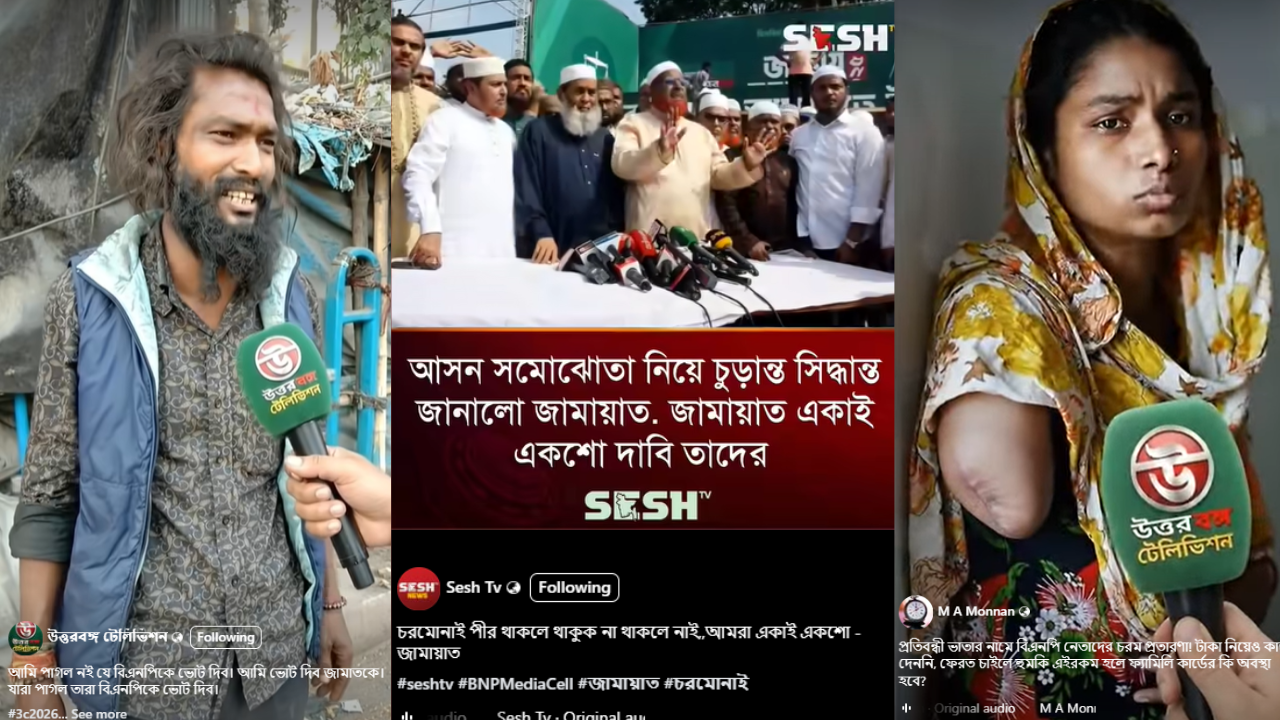

জাতীয় সংসদ নির্বাচনের আগে আসনবণ্টন ইস্যুতে ‘চরমোনাই পীরকে ৩০টির বেশি আসন দিতে পারব না, মন চাইলে তারা থাকুক না চাইলে না থাকুক’– এমন বক্তব্য জামায়াত নেতার নামে দেখিয়ে একটি ভিডিও ফেসবুকে ছড়ানো হয়। যাচাইয়ে গণমাধ্যম বা বিশ্বস্ত কোনো সূত্রে এ ধরনের বক্তব্যের প্রমাণ পাওয়া যায়নি এবং ভিডিওটির সম্ভাব্য উৎস হিসেবে Sesh Tv নামে একটি ফেসবুক পেজের ভিডিও পাওয়া যায়। পেজের বায়োতে স্পষ্ট লেখা, তাদের ভিডিওগুলো এআই দিয়ে তৈরি ও সিরিয়াসভাবে না নিতে বলা হয়েছে।

‘পিএনএএস নেক্সাস’-এ প্রকাশিত এক গবেষণায় বলা হয়েছে, চ্যাটজিপিটি ও জিপিটি-৩–এর মতো জেনারেটিভ এআই ব্যবহার করে একই রাজনৈতিক বিজ্ঞাপনকে ভিন্ন ভাষা এবং স্টাইলে স্বয়ংক্রিয়ভাবে লিখে একাধিক সংস্করণ তৈরি করা সম্ভব।

অ্যাক্টিভেট রাইটসের গবেষণা প্রধান মিনহাজ আমান বলেন, দেশে ডিজিটাল লিটারেসি খুব দুর্বল। অন্যদিকে সমাজ খুব বিভাজিত। ফলে পক্ষের যেকোনো কন্টেন্ট ইউজাররা যাচাই-বাছাইয়ের ধার ধারেন না। এসব কন্টেন্ট ভোটারদের ইশতেহার তুলনা ও প্রার্থী যাচাই করে সচেতন সিদ্ধান্ত নেওয়ার পথ বাধাগ্রস্ত করছে।

ভুয়া কনটেন্ট প্রতিরোধে সরকারসহ সংশ্লিষ্টদের সক্ষমতা নিয়ে প্রশ্ন তুলেছেন মিনহাজ আমান। তিনি বলেন, শঙ্কা জানানো হলেও বাস্তবে প্রস্তুতি প্রায় শূন্য। একইসঙ্গে সোশ্যাল মিডিয়া প্ল্যাটফর্মের নীতিমালায় এআই কনটেন্ট ফ্ল্যাগ করার কথা থাকলেও, তা কার্যকর হচ্ছে না। নির্বাচন কমিশন এবারের অভিজ্ঞতা থেকে শিক্ষা নিয়ে নীতি ও কার্যকর কাঠামো গড়লে, ভবিষ্যতে পরিস্থিতির উন্নতি সম্ভব হবে বলে মনে করেন তিনি।

আসন্ন নির্বাচনে মাঠের লড়াইয়ে প্রার্থীরা জড়াচ্ছেন বাকযুদ্ধে। একইসঙ্গে অনুসারীদের মাধ্যমে রাজত্ব চালাচ্ছেন ডিজিটাল মাধ্যমেও। এরই অংশ হিসেবে এআই দিয়ে ভুয়া ভিডিও বানিয়ে চলছে ভোটের প্রচার ও প্রতিপক্ষ ঘায়েল।

এসব ভিডিওতে জনমত প্রভাবিত করতে কখনো আইনশৃঙ্খলা রক্ষাকারী বাহিনীর পোশাক ব্যবহার করে নির্দিষ্ট দল বা প্রার্থীর পক্ষে-বিপক্ষে বক্তব্য জুড়ে দেওয়া হচ্ছে। আবার কখনো জনপ্রিয় তারকা ও পরিচিত ব্যক্তির নামে সাজানো ছবি-বার্তা ছড়িয়ে দেওয়া হচ্ছে। আচরণবিধি লঙ্ঘন করে এসব হলেও নির্বিকার নির্বাচন কমিশন (ইসি)।

‘রাজনৈতিক দল ও প্রার্থীর আচরণ বিধিমালা, ২০২৫’– এ সামাজিক মাধ্যম নিয়ে আলাদা বিধান রয়েছে। বিধি ১৬–তে বলা হয়েছে, নির্বাচন-সম্পর্কিত বিষয়ে অসৎ উদ্দেশ্যে এআই ব্যবহার ও ভুয়া অথবা ক্ষতিকর কনটেন্ট তৈরি-প্রচার নিষিদ্ধ।

সম্প্রতি ফেসবুকে নির্বাচন নিয়ে ১৮ সেকেন্ডের ভিডিও ছড়িয়ে পড়ে, যাতে সেনাবাহিনীর পোশাকে একজনকে জামায়াতে ইসলামীর ‘দাঁড়িপাল্লা’ প্রতীকে ভোট চাইতে দেখা যাচ্ছে। যাচাইয়ে স্ট্রিম এই ভিডিওর কণ্ঠস্বর ও পরিবেশগত উপস্থাপনায় কিছু অসঙ্গতি পেয়েছে। হাইভ ডিটেক্ট এআই প্ল্যাটফর্ম ভিডিওটি এআই নির্মিত হওয়ার উচ্চ সম্ভাবনা দেখায়। বাস্তবে এটি কৃত্রিম বুদ্ধিমত্তা ব্যবহারে তৈরি ভুয়া ভিডিও।

আবার সাবেক সেনাপ্রধান জেনারেল এস এম শফিউদ্দিন আহমেদের একটি ভিডিও ছড়িয়েছে, যাতে বিএনপি প্রার্থীদের ‘চোর-বাটপার’ বলে ভালো মানুষকে ভোট দিতে বলা হচ্ছে। অনুসন্ধানে জানা যায়, বাস্তবে শফিউদ্দিন আহমেদ এ ধরনের মন্তব্য করেননি। রিভার্স ইমেজ সার্চে দেখা যায়, ভিডিওর দৃশ্যটি ২০২৩ সালে টাঙ্গাইলে সেনাবাহিনীর শীতকালীন অনুশীলনের চূড়ান্ত মহড়ার ফুটেজ (১,২) থেকে নেওয়া এবং এআইয়ের মাধ্যমে বিভ্রান্তিকর বক্তব্য জুড়ে দেওয়া হয়েছে।

এমন আরেক ভিডিওতে সেনাবাহিনীর পোশাকে নিজেকে লেফটেন্যান্ট কর্নেল আজমাতুল্লাহ পরিচয় দিয়ে জামায়াতের বিপক্ষে ভোট দেওয়ার আহ্বান জানাচ্ছেন। ফ্যাক্টচেক প্রতিবেদন বলছে, সেনা কর্মকর্তার এই বক্তব্য দাবিতে প্রচার ভিডিও এআই নির্মিত।

ভোটারের সহানুভূতি আদায়ে এআই নির্মিত ভিডিও ব্যবহার করা হচ্ছে। ফেসবুকের একটি ভিডিওতে এক নারী বলছেন– প্রতিবন্ধী কার্ডের কথা বলে এক বিএনপি নেতা টাকা নিয়েও কার্ড দেননি। তাই তিনি বিএনপিকে ভোট দেবেন না; দাঁড়িপাল্লায় ভোট দেবেন। মূলত উত্তরবঙ্গ টেলিভিশন নামের ফেসবুক অ্যাকাউন্ট থেকে গত ১০ জানুয়ারি ভিডিওটি প্রথম পোস্ট করা হয়।

প্রতিবেদন অনুযায়ী, ভিডিওটি একটি স্থির ছবি থেকে প্রযুক্তির সাহায্যে ডিপফেক হিসেবে তৈরি করা। ভিডিও থেকে নেওয়া কি-ফ্রেম রিভার্স সার্চে ২০১৩ সালে এনবিসি নিউজে প্রকাশিত একটি প্রতিবেদনে (রানা প্লাজা দুর্ঘটনায় ডান হাত হারানো) রিক্তার ছবি পাওয়া যায়। তবে একই নারীর এই বক্তব্যসহ ভিডিও কোথাও পাওয়া যায়নি। ভিডিওতে মুখের ভঙ্গিমা এবং স্বাভাবিক কথোপকথনে অসঙ্গতি, এমনকি অডিওতে অস্বাভাবিকতা স্পষ্ট। গুগলের এআই টুল ও সংশ্লিষ্ট ওয়াটারমার্ক শনাক্ত (সিন্থআইডি) পরীক্ষায় ভিডিওটি এআই দিয়ে তৈরির প্রমাণ পাওয়া যায়।

ফেসবুকে সাম্প্রতিক সময়ে আবেগকে কাজে লাগিয়ে তৈরি এমন বহু ভুয়া কনটেন্ট ছড়িয়ে পড়েছে। জানুয়ারিতে ফেসবুকে কয়েকটি ছবি (১,২,৩) ছড়িয়ে পড়ে, যেখানে খল অভিনেতা ডিপজল, অভিনেতা জিয়াউল হক পলাশ এবং ক্রিকেটার মাহমুদউল্লাহ রিয়াদকে একটি প্ল্যাকার্ড ধরে শেখ হাসিনা ও আওয়ামী লীগের প্রতি সমর্থন জানাচ্ছেন। প্ল্যাকার্ডে লেখা ছিল— ‘ফ্যাসিস্ট দিয়ে যদি ভালো কিছু হয়। তবে ফ্যাসিস্টই ভালো।’ প্রতিবেদন অনুযায়ী, ছবিগুলো বাস্তব নয়; এগুলো কৃত্রিম বুদ্ধিমত্তা ব্যবহার করে তৈরি।

এবার নির্বাচনে ভাইরাল এআই নির্মিত কনটেন্টের মাধ্যমে প্রতিপক্ষকে কোণঠাসা করার কৌশল নতুন মাত্রা পেয়েছে। রাজনৈতিক পদত্যাগ ও আসনবণ্টনের মতো স্পর্শকাতর বিষয় ব্যবহার করে বিভ্রান্তি ছড়ানো হচ্ছে বেশি। জাতীয় নাগরিক পার্টির (এনসিপি) সিনিয়র যুগ্ম সদস্যসচিব পদ থেকে ডা. তাসনিম জারা পদত্যাগ করার পর টিকটকে একটি ভিডিও ছড়ানো হয়, যেখানে তাঁকে ‘এনসিপি রাজাকারদের একটি দল’ বলতে দেখা যায়। অনুসন্ধানে এই বক্তব্যের পক্ষে কোনো প্রমাণ পাওয়া যায়নি। তাসনিম জারার ফেসবুক পোস্টেও এনসিপি নিয়ে এমন মন্তব্য নেই। প্রতিবেদনে উল্লেখ করা হয়, ‘ডিপফেক-ও-মিটার’-এর ‘জিএলএফএফ (২০২৪)’ মডেলে পরীক্ষা করে ভিডিওটি কৃত্রিমভাবে তৈরি হওয়ার সম্ভাবনা শতভাগ পাওয়া যায়।

নয়াদিল্লির দ্য ওবেরয় হোটেলে ভারতের গোয়েন্দা সংস্থা ‘র’-এর এক কর্মকর্তার সঙ্গে বিএনপি নেতা আবদুল আউয়াল মিন্টু ও আমীর খসরু মাহমুদ চৌধুরীর বৈঠকের দৃশ্য দেখিয়ে ফেসবুকে চারটি ছবি ছড়ানো হয়। এই বিষয়ে দ্য ডিসেন্ট বলছে, ছবিগুলো কৃত্রিমভাবে তৈরি ও সম্পাদিত। অন্তত একটি ছবির ব্যাকগ্রাউন্ড ৬ বছর আগে নয়াদিল্লির ওবেরয় হোটেলের গুগল রিভিউতে পোস্ট করা একটি বাস্তব ছবি থেকে নেওয়া, যা পরে বিকৃত করে নতুন দৃশ্য তৈরি করা হয়েছে। একাধিক ওপেনসোর্স শনাক্তকরণ টুলেও একটি ছবিকে নিশ্চিতভাবে কৃত্রিমভাবে তৈরি বলে চিহ্নিত করা হয়। ছবিগুলোর উৎস হিসেবে Indus Sentinel Grid নামের একটি এক্স অ্যাকাউন্ট পাকিস্তান থেকে পরিচালিত এবং আগেও ভিত্তিহীন বিভ্রান্তিকর তথ্য ছড়ানোর রেকর্ড রয়েছে।

জাতীয় সংসদ নির্বাচনের আগে আসনবণ্টন ইস্যুতে ‘চরমোনাই পীরকে ৩০টির বেশি আসন দিতে পারব না, মন চাইলে তারা থাকুক না চাইলে না থাকুক’– এমন বক্তব্য জামায়াত নেতার নামে দেখিয়ে একটি ভিডিও ফেসবুকে ছড়ানো হয়। যাচাইয়ে গণমাধ্যম বা বিশ্বস্ত কোনো সূত্রে এ ধরনের বক্তব্যের প্রমাণ পাওয়া যায়নি এবং ভিডিওটির সম্ভাব্য উৎস হিসেবে Sesh Tv নামে একটি ফেসবুক পেজের ভিডিও পাওয়া যায়। পেজের বায়োতে স্পষ্ট লেখা, তাদের ভিডিওগুলো এআই দিয়ে তৈরি ও সিরিয়াসভাবে না নিতে বলা হয়েছে।

‘পিএনএএস নেক্সাস’-এ প্রকাশিত এক গবেষণায় বলা হয়েছে, চ্যাটজিপিটি ও জিপিটি-৩–এর মতো জেনারেটিভ এআই ব্যবহার করে একই রাজনৈতিক বিজ্ঞাপনকে ভিন্ন ভাষা এবং স্টাইলে স্বয়ংক্রিয়ভাবে লিখে একাধিক সংস্করণ তৈরি করা সম্ভব।

অ্যাক্টিভেট রাইটসের গবেষণা প্রধান মিনহাজ আমান বলেন, দেশে ডিজিটাল লিটারেসি খুব দুর্বল। অন্যদিকে সমাজ খুব বিভাজিত। ফলে পক্ষের যেকোনো কন্টেন্ট ইউজাররা যাচাই-বাছাইয়ের ধার ধারেন না। এসব কন্টেন্ট ভোটারদের ইশতেহার তুলনা ও প্রার্থী যাচাই করে সচেতন সিদ্ধান্ত নেওয়ার পথ বাধাগ্রস্ত করছে।

ভুয়া কনটেন্ট প্রতিরোধে সরকারসহ সংশ্লিষ্টদের সক্ষমতা নিয়ে প্রশ্ন তুলেছেন মিনহাজ আমান। তিনি বলেন, শঙ্কা জানানো হলেও বাস্তবে প্রস্তুতি প্রায় শূন্য। একইসঙ্গে সোশ্যাল মিডিয়া প্ল্যাটফর্মের নীতিমালায় এআই কনটেন্ট ফ্ল্যাগ করার কথা থাকলেও, তা কার্যকর হচ্ছে না। নির্বাচন কমিশন এবারের অভিজ্ঞতা থেকে শিক্ষা নিয়ে নীতি ও কার্যকর কাঠামো গড়লে, ভবিষ্যতে পরিস্থিতির উন্নতি সম্ভব হবে বলে মনে করেন তিনি।

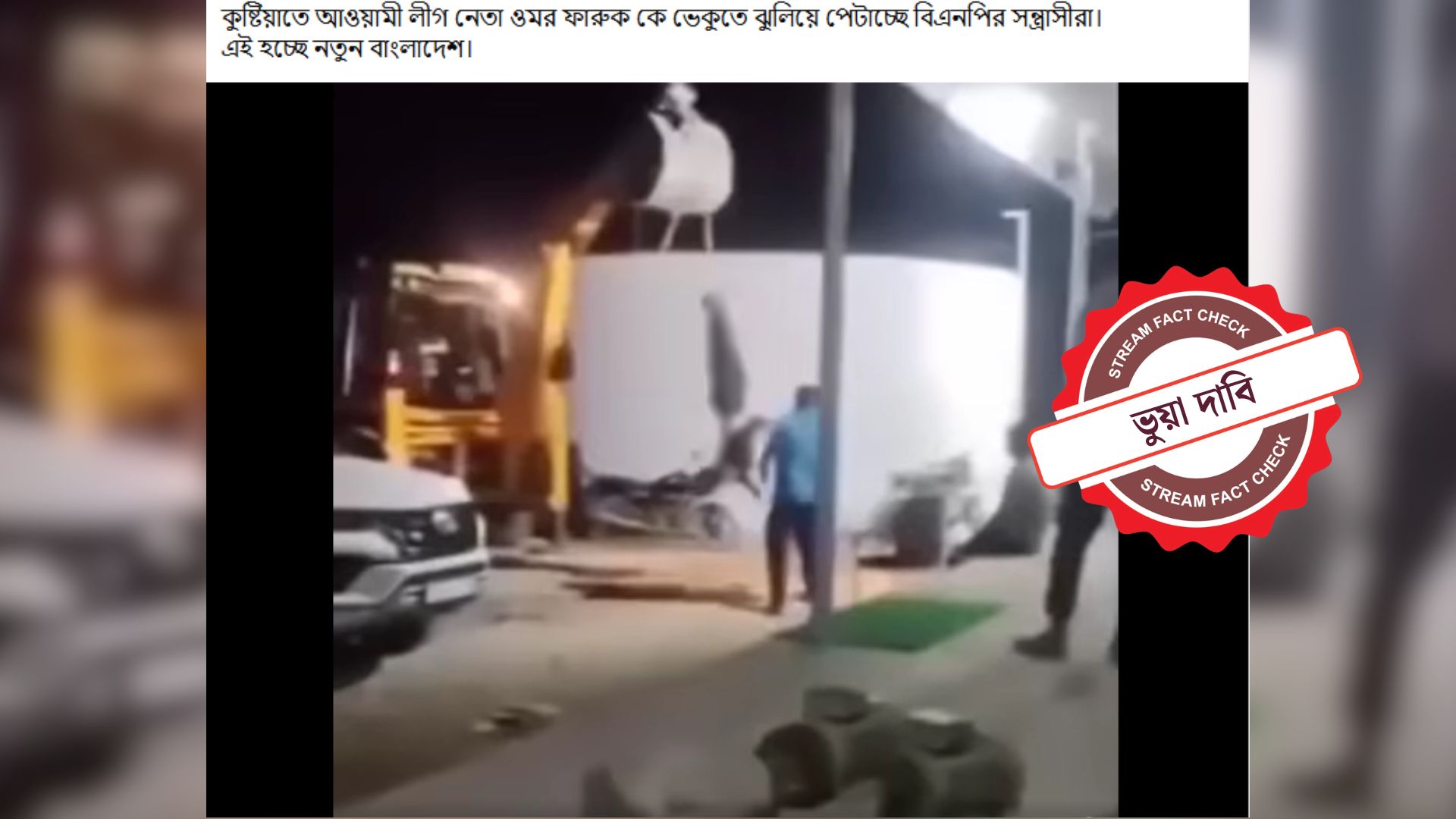

সম্প্রতি ফেসবুকে একটি ভিডিও ছড়িয়ে দাবি করা হয়েছে, কুষ্টিয়ায় আওয়ামী লীগ নেতা ওমর ফারুককে এস্কেভেটরে (স্থানীয়ভাবে ‘ভেকু’ নামে পরিচিত) ঝুলিয়ে পেটাচ্ছে বিএনপির সন্ত্রাসীরা। ভিডিওতে দেখা যায়, একজন ব্যক্তিকে ভেকুর বাকেটের অংশে উল্টো করে বেঁধে মারধর করা হচ্ছে।

২ ঘণ্টা আগে

আলোচিত ভিডিও বরিশাল থানায় ধর্ষণের বর্ণনা দেওয়ার কোনো দৃশ্য নয়। এটি কুমিল্লায় এনজিও কর্মীদের বিরুদ্ধে এক দম্পতিকে মারধর এবং লাঞ্ছনার অভিযোগের ঘটনার।

৭ দিন আগে

সম্প্রতি একটি ভিডিওতে দেখা যায়, এক নারী ও এক পুরুষের মধ্যে রাস্তার পাশে উত্তেজনা। ফেসবুকে ভিডিওটি ছড়িয়ে বলা হয়েছে, ভারতে বোরকা পরার অপরাধে এক নারীকে মারধর করা হয়েছে।

৭ দিন আগে

সম্প্রতি ফেসবুকে ব্রাজিলের জনপ্রিয় ফুটবলার নেইমার জুনিয়রের নামে একটি ভিডিও ভাইরাল হয়েছে। এতে দেখা যায়, ব্রাজিলের হলুদ জার্সি, ক্যাপ ও সানগ্লাস পরা ব্যক্তি টয়লেটে আছেন এবং বাইরের কয়েকজন তা মোবাইল ফোনে ধারণ করছেন। ভিডিওটি শেয়ার করে দাবি করা হচ্ছে, ছবির ব্যক্তি নেইমার।

৯ দিন আগে