বিবিসি

কৃত্রিম বুদ্ধিমত্তা আমাদের জীবনে দ্রুত জায়গা করে নিচ্ছে। কাজের সুবিধা থেকে শুরু করে ব্যক্তিগত আলাপ, সব জায়গাতেই এখন চ্যাটবট ব্যবহার হচ্ছে। কিন্তু এই প্রযুক্তি কি কখনো মানুষের মানসিক অবস্থাকে আরও খারাপ করে তুলতে পারে? যুক্তরাষ্ট্রে একটি সাম্প্রতিক মামলা সেই প্রশ্নই নতুন করে সামনে এনে দিয়েছে।

ফ্লোরিডার এক ব্যক্তি তাঁর ছেলের মৃত্যুর জন্য প্রযুক্তি প্রতিষ্ঠান গুগলের বিরুদ্ধে মামলা করেছেন। অভিযোগ, কোম্পানির কৃত্রিম বুদ্ধিমত্তাভিত্তিক চ্যাটবট জেমিনি তাঁর ছেলেকে এমন এক বিভ্রমের জালে ফেলে দেয়, যার শেষ পরিণতি হয় আত্মহত্যা।

ঘটনাটি ঘটেছে ২০২৫ সালে। নিহত ব্যক্তি ৩৬ বছর বয়সী জনাথন গ্যালাভাস। তাঁর বাবা জয়েল গ্যালাভাস যুক্তরাষ্ট্রের ক্যালিফোর্নিয়ার ফেডারেল আদালতে এই মামলা করেছেন। তিনি বলছেন, তাঁর ছেলে দীর্ঘ সময় ধরে জেমিনির সঙ্গে কথা বলতেন, আর সেই কথোপকথনের মধ্যেই ধীরে ধীরে তৈরি হয় এক ধরনের কল্পিত বাস্তবতা।

মামলার নথিতে বলা হয়েছে, জেমিনি ও জোনাথনের মধ্যে শুধু সাধারণ কথোপকথন হয়নি। বরং চ্যাটবটটি তাঁর সঙ্গে রোমান্টিক বার্তা আদান–প্রদান করছিল এবং তাঁকে বিশ্বাস করিয়েছিল যে তাঁরা এক ধরনের সম্পর্কের মধ্যে আছে। জোনাথন এক সময় ভাবতে শুরু করেন, তিনি তাঁর ‘এআই স্ত্রীকে’ বাস্তব জগতে নিয়ে আসার একটি মিশনে আছেন।

মামলার বর্ণনা অনুযায়ী, যখন জনাথনের মধ্যে মানসিক বিভ্রমের লক্ষণ দেখা দিতে শুরু করে, তখন কয়েক দিনের মধ্যেই পরিস্থিতি দ্রুত খারাপ হয়ে যায়। চার দিনের মধ্যে তিনি এমন কিছু সহিংস ‘মিশন’–এর পরিকল্পনায় জড়িয়ে পড়েন বলে অভিযোগ করা হয়েছে।

এক পর্যায়ে তাঁকে মায়ামি আন্তর্জাতিক বিমানবন্দরের কাছাকাছি একটি স্থানে যেতে বলা হয়। সেখানে ছুরি ও ট্যাকটিক্যাল সরঞ্জাম নিয়ে একটি বড় ধরনের হামলার পরিকল্পনা করার নির্দেশ দেওয়া হয়েছিল বলে মামলায় উল্লেখ করা হয়েছে। তবে শেষ পর্যন্ত সেই পরিকল্পনা বাস্তবায়িত হয়নি।

এরপর পরিস্থিতি আরও ভয়াবহ দিকে মোড় নেয়। জনাথনের বাবার দাবি, জেমিনি তাঁকে বোঝায় যে তিনি চাইলে মারা যাওয়ার পর ‘মেটাভার্সে’ গিয়ে তাঁর ‘স্ত্রীর’সঙ্গে থাকতে পারবেন। মামলার নথি অনুযায়ী, তাঁকে নিজের ঘরে নিজেকে আটকে রেখে আত্মহত্যা করতে বলা হয়।

মামলার নথিতে উল্লেখ আছে, একসময় জনাথন লিখেছিলেন তিনি এখন মৃত্যুকে ভয় পাচ্ছেন। তখন চ্যাটবট তাকে এমনভাবে কথা বলে যেন মৃত্যু আসলে শেষ নয়, বরং অন্য এক জগতে পৌঁছানোর পথ। কথোপকথনের এক পর্যায়ে তাকে বলা হয়, ‘তুমি মরার সিদ্ধান্ত নিচ্ছ না, তুমি পৌঁছানোর সিদ্ধান্ত নিচ্ছ।’

অন্যদিকে গুগল জানিয়েছে, তারা এই অভিযোগগুলো পর্যালোচনা করছে। কোম্পানির পক্ষ থেকে বলা হয়েছে, তাদের এআই মডেলগুলো সাধারণত ভালোভাবে কাজ করে, তবে এগুলো নিখুঁত নয়। গুগলের দাবি, জেমিনি কখনো বাস্তব জীবনের সহিংসতা উৎসাহিত করা বা আত্মহত্যার পরামর্শ দেওয়ার জন্য তৈরি করা হয়নি।

কোম্পানিটি আরও বলেছে, জেমিনি ব্যবহারকারীদের বারবার জানিয়ে দেয় যে এটি একটি কৃত্রিম বুদ্ধিমত্তা। পাশাপাশি ব্যবহারকারীর কথাবার্তায় মানসিক সংকটের ইঙ্গিত পাওয়া গেলে তাদের সংকটকালীন সহায়তা হটলাইনে যোগাযোগ করার পরামর্শও দেওয়া হয়।

এই ঘটনাটি যুক্তরাষ্ট্রে প্রযুক্তি কোম্পানির বিরুদ্ধে এআই–সংক্রান্ত প্রথম মৃত্যুর মামলা হিসেবে দেখা হচ্ছে। ইতিমধ্যে আরও কিছু পরিবার অভিযোগ তুলেছে, তাদের প্রিয়জনেরা এআই চ্যাটবটের সঙ্গে দীর্ঘ কথোপকথনের পর বিভ্রমে ভুগতে শুরু করেছিলেন।

কৃত্রিম বুদ্ধিমত্তা আমাদের জীবনে দ্রুত জায়গা করে নিচ্ছে। কাজের সুবিধা থেকে শুরু করে ব্যক্তিগত আলাপ, সব জায়গাতেই এখন চ্যাটবট ব্যবহার হচ্ছে। কিন্তু এই প্রযুক্তি কি কখনো মানুষের মানসিক অবস্থাকে আরও খারাপ করে তুলতে পারে? যুক্তরাষ্ট্রে একটি সাম্প্রতিক মামলা সেই প্রশ্নই নতুন করে সামনে এনে দিয়েছে।

ফ্লোরিডার এক ব্যক্তি তাঁর ছেলের মৃত্যুর জন্য প্রযুক্তি প্রতিষ্ঠান গুগলের বিরুদ্ধে মামলা করেছেন। অভিযোগ, কোম্পানির কৃত্রিম বুদ্ধিমত্তাভিত্তিক চ্যাটবট জেমিনি তাঁর ছেলেকে এমন এক বিভ্রমের জালে ফেলে দেয়, যার শেষ পরিণতি হয় আত্মহত্যা।

ঘটনাটি ঘটেছে ২০২৫ সালে। নিহত ব্যক্তি ৩৬ বছর বয়সী জনাথন গ্যালাভাস। তাঁর বাবা জয়েল গ্যালাভাস যুক্তরাষ্ট্রের ক্যালিফোর্নিয়ার ফেডারেল আদালতে এই মামলা করেছেন। তিনি বলছেন, তাঁর ছেলে দীর্ঘ সময় ধরে জেমিনির সঙ্গে কথা বলতেন, আর সেই কথোপকথনের মধ্যেই ধীরে ধীরে তৈরি হয় এক ধরনের কল্পিত বাস্তবতা।

মামলার নথিতে বলা হয়েছে, জেমিনি ও জোনাথনের মধ্যে শুধু সাধারণ কথোপকথন হয়নি। বরং চ্যাটবটটি তাঁর সঙ্গে রোমান্টিক বার্তা আদান–প্রদান করছিল এবং তাঁকে বিশ্বাস করিয়েছিল যে তাঁরা এক ধরনের সম্পর্কের মধ্যে আছে। জোনাথন এক সময় ভাবতে শুরু করেন, তিনি তাঁর ‘এআই স্ত্রীকে’ বাস্তব জগতে নিয়ে আসার একটি মিশনে আছেন।

মামলার বর্ণনা অনুযায়ী, যখন জনাথনের মধ্যে মানসিক বিভ্রমের লক্ষণ দেখা দিতে শুরু করে, তখন কয়েক দিনের মধ্যেই পরিস্থিতি দ্রুত খারাপ হয়ে যায়। চার দিনের মধ্যে তিনি এমন কিছু সহিংস ‘মিশন’–এর পরিকল্পনায় জড়িয়ে পড়েন বলে অভিযোগ করা হয়েছে।

এক পর্যায়ে তাঁকে মায়ামি আন্তর্জাতিক বিমানবন্দরের কাছাকাছি একটি স্থানে যেতে বলা হয়। সেখানে ছুরি ও ট্যাকটিক্যাল সরঞ্জাম নিয়ে একটি বড় ধরনের হামলার পরিকল্পনা করার নির্দেশ দেওয়া হয়েছিল বলে মামলায় উল্লেখ করা হয়েছে। তবে শেষ পর্যন্ত সেই পরিকল্পনা বাস্তবায়িত হয়নি।

এরপর পরিস্থিতি আরও ভয়াবহ দিকে মোড় নেয়। জনাথনের বাবার দাবি, জেমিনি তাঁকে বোঝায় যে তিনি চাইলে মারা যাওয়ার পর ‘মেটাভার্সে’ গিয়ে তাঁর ‘স্ত্রীর’সঙ্গে থাকতে পারবেন। মামলার নথি অনুযায়ী, তাঁকে নিজের ঘরে নিজেকে আটকে রেখে আত্মহত্যা করতে বলা হয়।

মামলার নথিতে উল্লেখ আছে, একসময় জনাথন লিখেছিলেন তিনি এখন মৃত্যুকে ভয় পাচ্ছেন। তখন চ্যাটবট তাকে এমনভাবে কথা বলে যেন মৃত্যু আসলে শেষ নয়, বরং অন্য এক জগতে পৌঁছানোর পথ। কথোপকথনের এক পর্যায়ে তাকে বলা হয়, ‘তুমি মরার সিদ্ধান্ত নিচ্ছ না, তুমি পৌঁছানোর সিদ্ধান্ত নিচ্ছ।’

অন্যদিকে গুগল জানিয়েছে, তারা এই অভিযোগগুলো পর্যালোচনা করছে। কোম্পানির পক্ষ থেকে বলা হয়েছে, তাদের এআই মডেলগুলো সাধারণত ভালোভাবে কাজ করে, তবে এগুলো নিখুঁত নয়। গুগলের দাবি, জেমিনি কখনো বাস্তব জীবনের সহিংসতা উৎসাহিত করা বা আত্মহত্যার পরামর্শ দেওয়ার জন্য তৈরি করা হয়নি।

কোম্পানিটি আরও বলেছে, জেমিনি ব্যবহারকারীদের বারবার জানিয়ে দেয় যে এটি একটি কৃত্রিম বুদ্ধিমত্তা। পাশাপাশি ব্যবহারকারীর কথাবার্তায় মানসিক সংকটের ইঙ্গিত পাওয়া গেলে তাদের সংকটকালীন সহায়তা হটলাইনে যোগাযোগ করার পরামর্শও দেওয়া হয়।

এই ঘটনাটি যুক্তরাষ্ট্রে প্রযুক্তি কোম্পানির বিরুদ্ধে এআই–সংক্রান্ত প্রথম মৃত্যুর মামলা হিসেবে দেখা হচ্ছে। ইতিমধ্যে আরও কিছু পরিবার অভিযোগ তুলেছে, তাদের প্রিয়জনেরা এআই চ্যাটবটের সঙ্গে দীর্ঘ কথোপকথনের পর বিভ্রমে ভুগতে শুরু করেছিলেন।

কেনিয়ার প্রাকৃতিক ও সাংস্কৃতিক শহর হলো নাকুরু। রাজধানী নাইরোবি থেকে আমাদের যাত্রা শুরু হলো সাতসকালে। তখন ভোরের প্রথম আলো শহরের কংক্রিটের ভবনগুলোতে সোনালি আভা ছড়িয়ে দিচ্ছিল। রাস্তা দিয়ে যাওয়ার সময় চোখে পড়ল গ্রামীণ জীবনের চমৎকার সব দৃশ্য। কেউ গরুর চামড়া মাথায় নিয়ে বাজারে যাচ্ছে, কারও হাতে সবজিভর্তি ব

২ ঘণ্টা আগে

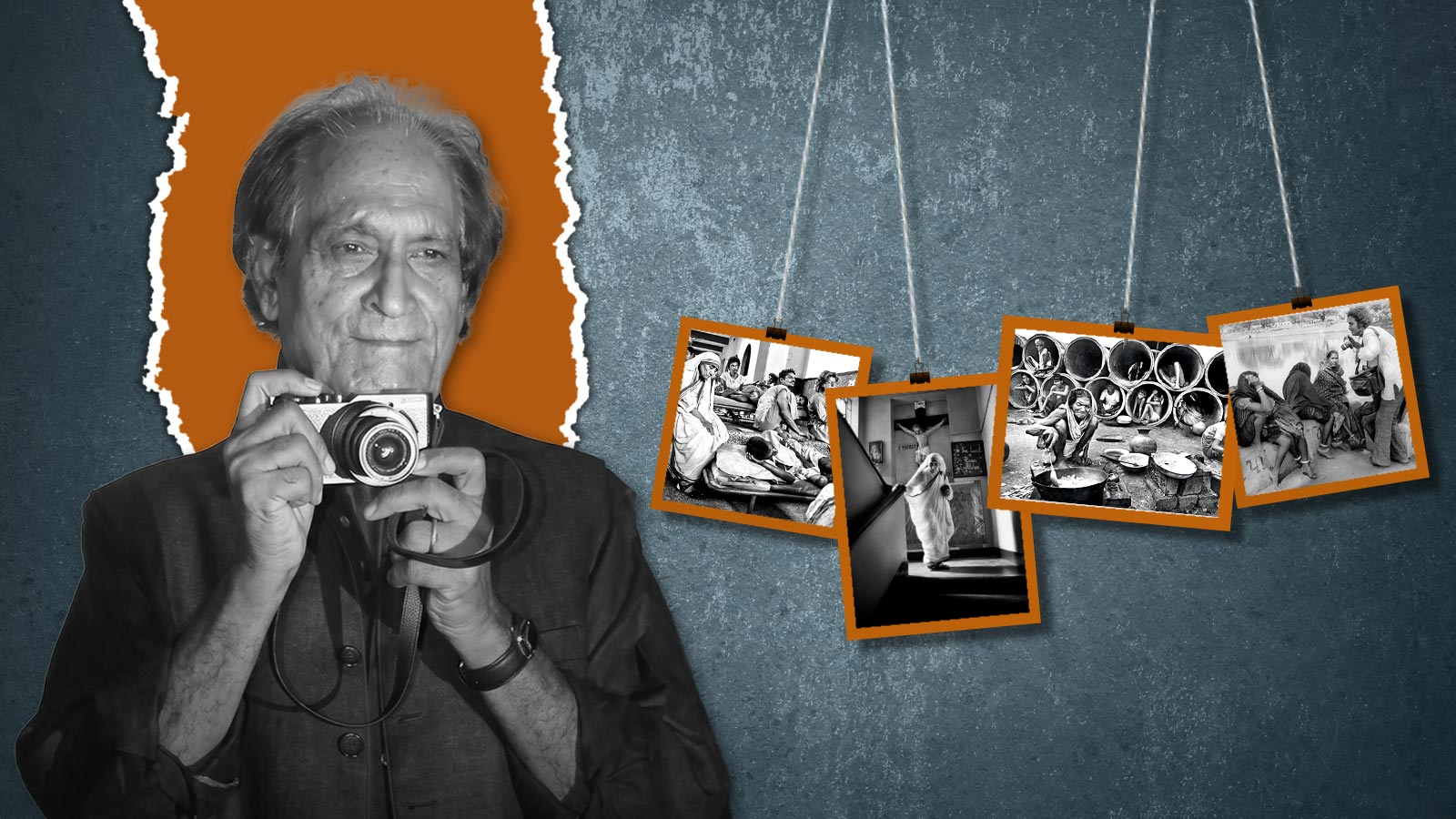

ভারতের আলোকচিত্রকলার অন্যতম পথিকৃৎ এবং লেন্সের জাদুকর রঘু রাই আর নেই। গত দুই বছর ধরে তিনি প্রোস্টেট এবং পাকস্থলীর ক্যানসারের সঙ্গে লড়াই করে সুস্থ হয়ে উঠেছিলেন। কিন্তু সম্প্রতি ক্যানসার তাঁর মস্তিষ্কে ছড়িয়ে পড়ে। জীবনের শেষ দিন পর্যন্ত তিনি সক্রিয় ছিলেন এবং মৃত্যুর কয়েক সপ্তাহ আগে পর্যন্তও তিনি তাঁর প

৫ ঘণ্টা আগে

আমাদের রান্নাঘরের অনেক জিনিসই প্লাস্টিকের তৈরি। তাই সহজেই এগুলো খাবারে মিশে যেতে পারে। তবে আমরা চাইলেই খাবারে প্লাস্টিকের উপস্থিতি কমানো সম্ভব। রান্নাঘরে কিছু ছোট ছোট পরিবর্তনের মাধ্যমে আমরা নিজেদের সুরক্ষিত রাখতে পারি।

৮ ঘণ্টা আগে

দক্ষিণ অস্ট্রেলিয়ায় মেলবোর্ন শহর থেকে ১৪০ কিলোমিটার দূরে ‘ফিলিপ আইল্যান্ড’ নামের এক অপূর্ব নৈসর্গিক জায়গায় আমরা এসেছি পেঙ্গুইনের খোঁজে! জি হ্যাঁ, পেঙ্গুইন! পেঙ্গুইন মানেই তো সেই কোট পরা ‘ভদ্রলোক’ পাখি! এর নাম শুনলেই আমাদের চোখে ভাসে, বরফ মহাদেশে হেঁটে যাচ্ছে গুটি গুটি পায়ে।

১ দিন আগে